*僅供醫學專業人士閱讀參考

8年前,一位女士由於脊髓性肌萎縮側索硬化症(ALS)進行性癱瘓,基本失去了正常語言能力。如今,她又可以重新「開口說話」了。

根據近期發表在預印本平台bioRixv上的一篇論文[1],這位患者(受試者T12)接受了腦機接口植入,經過訓練後可以以每分鐘62個單詞的速度進行交流,這達到了以往技術最高水平的3倍,已經大大接近了無語言障礙者每分鐘160個單詞的語速。

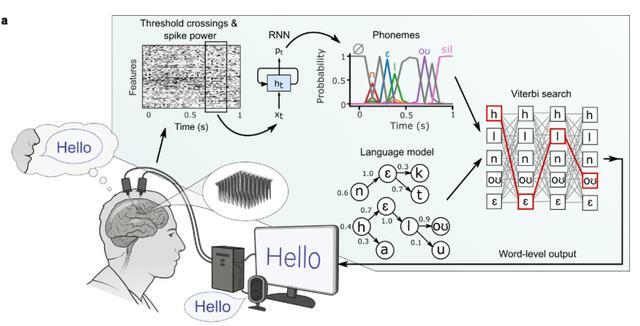

論文題圖

即使已經進入網際網路時代,我們擁有了各種即時通訊方法,在文字外又獲得了emoji和表情包等表達方式,但不可否認的是,「說話」仍然是人與人之間最快速的交流方式。

如何讓由於疾病或意外困於身體牢籠的患者們重獲與外界交互的能力?腦機接口或許能夠成為科技賦能的「讀心術」。

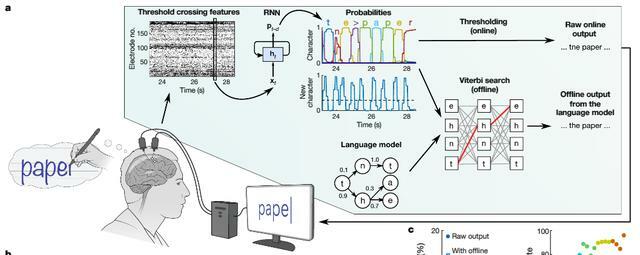

當然了,腦機接口實際上並不能「讀心」,它直接解讀的並非當事人心中想法,而是通過放置在運動皮層的微小電極來解析癱瘓者未能實現的肢體動作。

在之前的同類研究中,受試者被要求想像手部的動作,藉由腦機接口解碼神經信號,在電子屏幕上移動光標、選擇詞句乃至操控機械臂。本文通訊作者Krishna Shenoy和Jaimie Henderson即是領域內翹楚,2021年5月發表於《自然》的一篇論文中[2],他們設計的腦機接口創新性地識別受試者寫字動作的神經信號,實現了每分鐘18個詞的傑出表現。

不過正如前文所述,「說話」仍舊是遠超文字的最快的交流方式,腦機接口是否有希望直接當「嘴替」呢?

這要比解讀其他肢體動作更困難。雖然對我們來說,說話好像是一件很容易的事情,但現在請你嘗試感受一下發音時的口面肌肉動作——從喉嚨、舌頭到嘴唇,數十塊肌肉精密協作,輕輕振動空氣,才能發出特定的聲音。能否解碼這些細微的動作,是研究的關鍵一步。

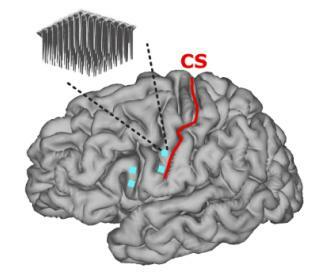

研究者們選擇了腹側前運動皮層(6v)和布羅卡區分別放下兩個微電極陣列,嘗試解讀受試者T12的「話語」。T12患有延髓起病型ALS,言語能力已經大幅度退化,口面運動受限,僅能發出一些含混不清的聲音。

在對應的腦區放下微陣列電極

幸運的是,6v區神經信號非常清晰,能夠以相當高的精度區分開不同口面運動,區分34種口面運動精度達到92.7%,區分39個音素(語音的最小單位)的精度也達到了60%。

有意思的是,在我們認為的語言運動中樞布羅卡區卻幾乎沒有發現相應的可用信號。

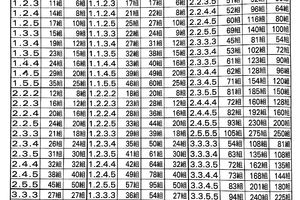

接下來,研究者們訓練了一個步長為80ms的循環神經網絡,來實時解碼神經信號,並結合了語言模型來提高解碼速度和準確性。研究者還使用了兩個不同的詞庫,一個包括能滿足簡單日常生活的50個英文單詞,另一個則涵蓋了英文常用的12萬5千個單詞。此外,受試者T12也使用了「朗讀」和「默讀」兩種方法來讀例句。

腦機接口運行思路

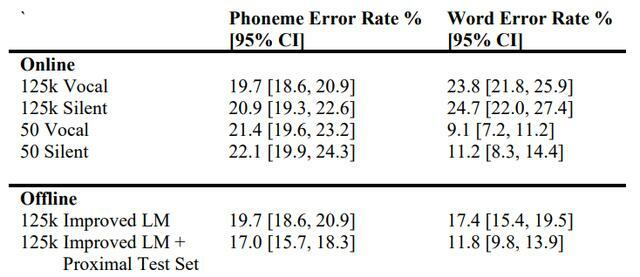

訓練成果相當喜人,50詞版本單詞錯誤率僅有9.1%,而既往研究最佳記錄也是這個數字的2.7倍;125k詞版本單詞錯誤率23.8%,而此前從未在這麼大的數據集中做過測試。如果進一步改進語言模型,錯誤率還可以繼續降低。

最令人驚喜的是每分鐘62詞的輸出速度,這是之前極限每分鐘18詞的三倍有餘。

不同模型的錯誤率

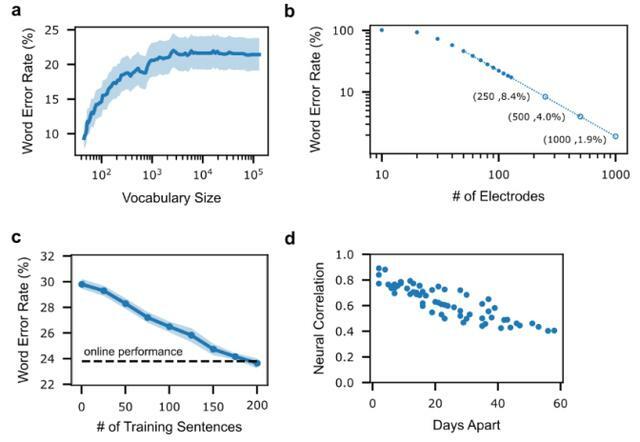

研究者還討論了能夠進一步提高識別精度的思路。

研究中使用了兩個不同大小的詞庫,研究者發現,單詞錯誤率在約1000詞左右達到飽和,相對的僅有50-100詞的小詞庫才能顯著提高準確率,所以詞庫的大小對於調整模型準確率來說並不特別實用。

而微陣列電極的數量對解碼精度是有助力的,未來更高通量的電極應當能夠帶來更好的使用體驗。

另外,研究者發現,隨著時間的變化,神經活動也是在改變的,這意味著需要多次訓練模型,加入無監督算法也是可行且有必要的。

影響準確性的幾個因素

遺憾的是,在論文上線的同一天,通訊作者之一Krishna Shenoy因胰腺癌去世,我們無法看到這項技術在他手中繼續進化的模樣了。

參考資料:

[1]https://www.biorxiv.org/content/10.1101/2023.01.21.524489v1.full.pdf

[2]https://www.nature.com/articles/s41586-021-03506-2

[3]https://www.technologyreview.com/2023/01/24/1067226/an-als-patient-set-a-record-for-communicating-via-a-brain-implant-62-words-per-minute/

本文作者丨代絲雨